人工知能(AI)の技術が急速に発展するにつれて、AIの「聞く」能力和「見る」能力が私たちの生活や仕事の方法を劇的に変えるようになってきました。音声認識から画像認識まで、AIは音を通じて私たちと対話し、視覚的な情報を理解して周囲の世界を分析することができるようになりました。これらの技術の進歩は非常に興奮を呼び起こすものであり、未来に対する期待を高めています。

一、音声認識:機械が言葉を理解する

音声認識は、人工知能技術の重要な分野の一つです。この技術は、機械が人間の言葉を理解し、処理できるようにします。このプロセスでは、音声信号を文字や命令に変換して、コンピューターや他のデバイスとの対話が可能になります。音声認識技術の登場は、私たちが技術と対話する方法を変えるだけでなく、多くの業界での革新と進歩を促進しました。

(一)音声認識の基本原理

音声認識の動作原理は、いくつかの重要なステップに分けることができます:

音声信号の捕捉と前処理

音声認識の最初のステップは、人間が発する音をデジタル信号に変換することです。通常は、マイクで音声を収集し、ノイズを除去したり、信号を強化したりして、音声情報を鮮明に抽出します。

特徴抽出

処理された音声信号に対して、システムは音声の特徴(例えば、音素(音声の最小単位)、周波数など)を抽出します。これらの特徴は、コンピューターが異なる音声要素を区別するのに役立ちます。

モデルの学習とマッチング

音声認識システムは、音声特徴を事前に定義された言語モデルとマッチングするためのモデルを機械学習アルゴリズムで学習します。従来の方法では隠れマルコフモデル(HMM)が使われることが多かったですが、現代の技術では、認識精度を高めるために深層ニューラルネットワーク(DNN)が広く使われています。

言語の解釈と出力

最後に、システムは認識された音声信号を対応する文字や命令に変換し、ユーザーにフィードバックします。

(二)技術の進歩

過去の音声認識技術は、ルールやテンプレートマッチングに依存していたため、正確性に制限があり、特に騒がしい環境や強いアクセントの音声では認識精度が悪くなりました。しかし、深層学習とニューラルネットワーク技術の発展によって、現代の音声認識システムは大量のデータを学習することができるようになりました。これにより、音声を文字に変換する精度が大幅に向上しました。最近では、深層ニューラルネットワーク(DNN)や畳み込みニューラルネットワーク(CNN)の応用によって、音声認識の正確率が大幅に向上しました。深層学習を通じて、システムは大量のデータからより豊富な音声特徴を抽出することができ、複雑な環境(例えば、遠隔音声認識、複数話者の音声分離など)での性能を向上させることができます。

(三)应用场景

音声認識技術は、多くの分野で広く応用されています:

仮想アシスタント:例えば、AppleのSiri、AmazonのAlexa、Googleアシスタントなど、音声認識のおかげで、これらのスマートアシスタントはユーザーの音声コマンドを理解して対応できるようになりました。ユーザーは音声でデバイスを操作したり、情報を探したり、リマインダーを設定したりすることができます。

自動音声トランスクリプト:音声認識は、ニュース取材、裁判所の記録、会議の議事録などにおいて、自動化されたトランスクリプトを実現し、労働効率を大幅に向上させました。

スマートカスタマーサービス:ますます多くの企業が、顧客の音声リクエストを自動処理するための音声認識技術を採用し始めています。これにより、人間のカスタマーサービスを解放し、応答速度と顧客満足度を向上させることができます。

音声翻訳:音声認識と機械翻訳を組み合わせることで、リアルタイムの跨言語コミュニケーションを実現することができます。例えば、Google Translateのようなアプリケーションは、音声内容を直接認識して翻訳することができ、世界中のコミュニケーションをより便利にしています。

(四)課題と展望

音声認識技術は著しい進歩を遂げていますが、まだいくつかの課題に直面しています:

ノイズの干渉:騒がしい環境では、音声認識の正確度が大幅に低下する可能性があります。バックグラウンドノイズを処理し、鮮明な音声信号を抽出する方法は、重要な難問です。

アクセントと方言の違い:世界には多くの異なる言語と方言がありますが、音声認識システムは、強烈なアクセントを持つユーザーに対しては、しばしば不十分なパフォーマンスを示します。将来、AIシステムは多様な音声特徴を学習し、適応する必要があるでしょう。

感情とトーンの認識:人間の声は、単なる文字情報だけでなく、豊富な感情やトーンの要素も含んでいます。将来の音声認識システムは、これらの非言語的な情報もよりよく理解し、より自然で表現力豊かな対話が実現できるようにする必要があります。

技術の継続的な進歩により、音声認識システムの正確性と応用範囲はさらに拡大され、人間と機械の対話のインテリジェンス化プロセスをさらに推進する革新的なアプリケーションが登場するでしょう。

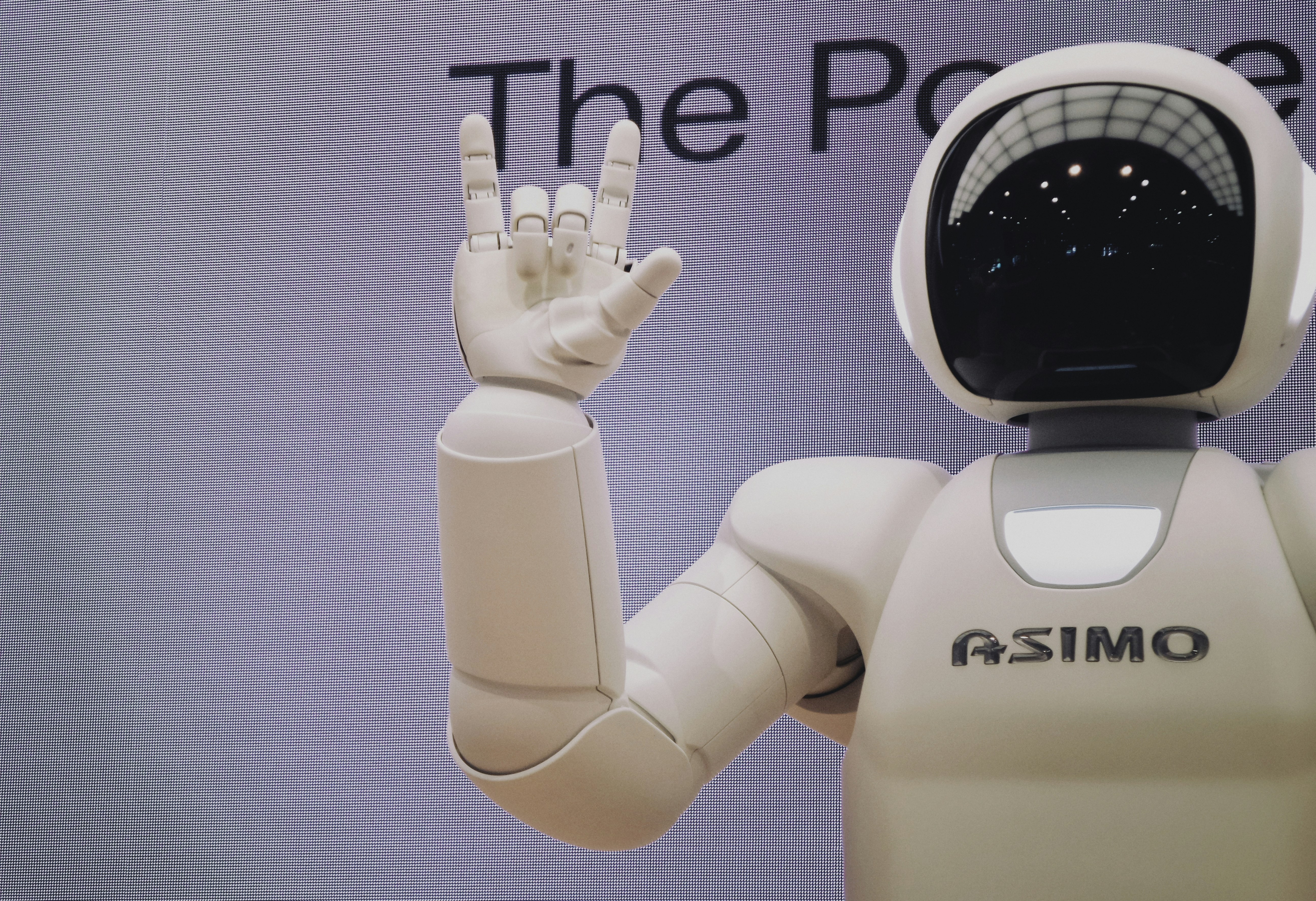

二、画像認識:機械が世界を理解する

画像認識は、人工知能分野における別の重要なブレイクスルーです。この技術により、機械は視覚情報を「見る」ことと「理解」ことができるようになりました。画像認識技術を通じて、コンピューターは画像やビデオ内の物体、シーン、文字などの要素を認識し、分析し、賢い判断を行うことができます。音声認識と同様に、画像認識技術は、人間と機械の対話の改善、生産性の向上、そして革新の促進において重要な役割を果たしています。

(一)画像認識の基本原理

画像認識の基本プロセスは、主に以下のいくつかのステップに分けることができます:

画像の取得と前処理

カメラやその他のデバイスで画像を取得した後、システムは画像を処理し、ノイズを除去したり、明るさを調整したり、色を補正したりして、後続の分析に備えます。

特徴抽出

画像の特徴抽出は、画像認識の鍵となるステップです。従来の方法では、人工的に設計された特徴(例えば、エッジ、コーナー、テクスチャなど)に依存していましたが、現代の深層学習方法では、畳み込みニューラルネットワーク(CNN)が画像から複雑な特徴を自動的に学習します。

モデルの学習と分類

画像認識のコアは、大量のラベル付けされた画像データを用いて学習し、新しい画像を自動的に認識できるモデルを構築することです。深層ニューラルネットワーク、特に畳み込みニューラルネットワーク(CNN)は、このプロセスで強力な学習能力を示しました。

結果の出力と決定

画像が処理され、分析された後、システムは認識結果(例えば、画像内の物体、シーンカテゴリ、認識された文字情報など)を出力します。通常は、ラベルやカテゴリの形式で表示されます。

会社名:株式会社Dolphin AI

事業内容:

Dolphin SOE 英語発音評価サービスの開発&販売

Dolphin Voice 音声対話SaaS Platformの開発&販売

ドルフィンAIは自社開発のAI技術を持つ研究開発型のハイテク企業です。

独自技術の音声対話意図理解モデル(Dolphin Large Language Models)に基づき、音声認識、音声生成、意味理解、テキスト生成、機械翻訳、声紋認識、その他音声対話のフルチェーン技術を開発し、日本語、英語、中国語、韓国語、フランス語、スペイン語、ロシア語、ドイツ語、チベット語、タイ語、ベトナム語など20以上の言語に対応しています。

また、SaaSやオンプレミスのサービス形態を通じて、教育、医療、金融、その他の分野のお客様に基礎となるAI技術と業界ソリューションを提供しています。

アクセス情報:〒170-0013

東京都豊島区東池袋1-18-1 Hareza Tower 20F

JR山手線・埼京線 池袋駅東口(30番出口)より徒歩4分

東京メトロ丸の内線・副都心線・有楽町線 池袋駅東口(30番出口)より徒歩4分

西武池袋線 池袋駅東口(30番出口)より徒歩4分

東武東上線 池袋駅東口(30番出口)より徒歩4分

電話番号:(+81) 03-6775-4523

メールアドレス:contact@dolphin-ai.jp